iOS 15 中的儿童安全是什么意思?

儿童安全是 iOS 15 的一项功能,旨在遏制儿童性虐待材料 (CSAM) 的传播,并帮助保护儿童免受使用通信工具对其进行剥削的掠夺者的侵害。Apple 将首先在美国推出该功能,然后其他地区也会跟进。这是一个三重功能,有可能让父母放心。与往常一样,这项新增功能正在免费实施。唯一的先决条件是iOS 15。

Apple 正与顶级儿童安全专家密切合作,以使该系统尽可能万无一失。

Apple 如何在 iOS 15 中实施儿童安全?

儿童安全功能集并非一蹴而就;苹果已经通过多次迭代完善了它。在目前的形式中,iOS 15 中的儿童安全分为三个部分。第一部分是默认消息应用程序中的通信安全。第二个是 iCloud 照片中的 CSAM 扫描。最后,第三部分以更安全的 Siri 和搜索指导的形式出现。下面,我们将了解这些是什么意思。

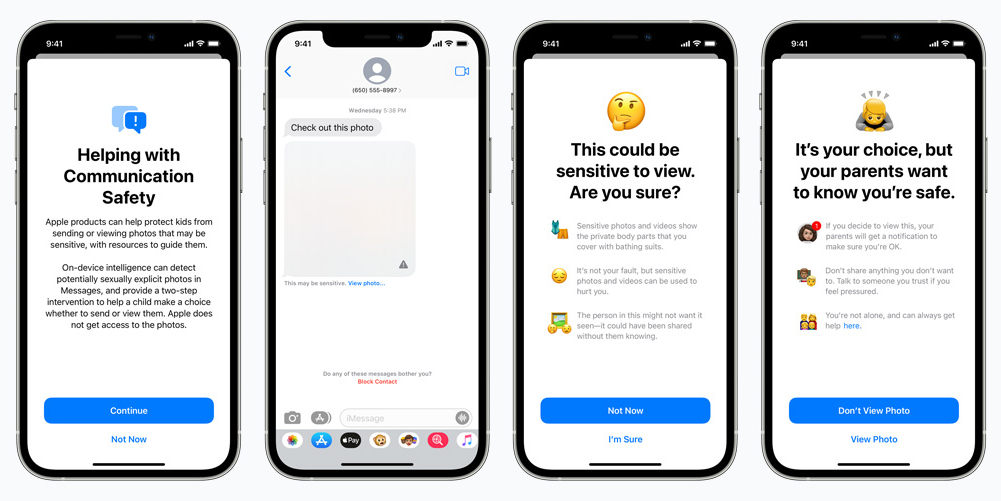

消息应用程序中的通信安全

iOS 中的默认消息应用程序可以说是 Apple 设备中最引人注目的部分之一,这就是为什么这个过滤系统有可能特别有效的原因。通信安全为您孩子的消息 UI 添加了一个附加层。当他们收到色情图片时,照片会变得模糊,并被告知照片的敏感性质。如果他们仍希望继续,则可以向父母或监护人发送警报。如果未成年人选择发送色情照片,同样的过滤系统就会发挥作用。如果他们的孩子选择忽略警告并按下发送键,父母会收到警报。

此功能仅适用于在 iOS 15、iPadOS 15 和 macOS Monterey 的 iCloud 中设置为家庭的帐户。

iCloud 照片中的 CSAM 检测

iCloud 照片中的 CSAM 检测是儿童安全计划最广泛的实施。它影响了每个将照片备份到 iCloud 的用户,这在最近引起了媒体的一些骚动。为了检测和防止儿童性虐待材料 (CSAM) 的传播,Apple 正在使用先进的加密技术。在检测到图像并证明其违反准则后,iOS 15 和 iPadOS 15 设备会将实例报告给国家失踪和受虐儿童中心 (NCMEC)。NCMEC 是所有 CSAM 支持的报告的中心,并与美国各地的执法部门密切合作以惩罚违法者。

“扫描”照片可能会引发一些危险信号,但 Apple 确保它不会扫描 iCloud 上的所有照片。它只扫描适合特定配置文件的照片。该简介由 NCMEC 和其他儿童安全服务机构提供。设备端机器学习在 CSAM 检测中发挥着重要作用。它限制曝光并准确分析敏感照片,让父母安心。

Siri 和搜索中更安全的指导

而 iCloud 和通信安全中的 CSAM 检测侧重于保护未成年儿童免受暴露。Siri 和搜索中更安全的指导是向用户介绍问题行为。如果用户使用 Siri 语音搜索或常规搜索来搜索与儿童性虐待材料相关的查询,iOS 15 会发出警告消息进行干预。该警告解释说,对此类主题的兴趣是有问题且有害的。iOS 15 甚至提供了资源来帮助解决这个问题。

你能关闭儿童安全吗?

Child Safety 本质上是内置于 iOS 15 中的。因此,您不能永远对它不屑一顾。但是,您必须满足几个条件才能使服务按预期运行。首先,“通信安全”功能专用于设置为“家庭”的帐户。独立帐户没有此功能。此外,截至目前,CSAM 检测仅在 iCloud 照片中起作用。如果您没有 iCloud,iOS 15 将不会扫描您的私人图书馆以获取 CSAM。

没有明显的切换来关闭服务,只有间接的方法来禁用它。

经常问的问题

每个人都可以访问 Messages 中的通信安全吗?

不,标准帐户持有人无法访问通信安全。您的帐户需要在 iCloud 设置中设置为“家庭”,然后才能在 iOS 15 中使用儿童安全功能。

新的儿童安全措施会破坏隐私吗?

苹果在照片扫描公告方面已经面临很多批评。但是,该公司确保它无意扫描您的所有照片,也不会访问您的任何照片或消息。它将简单地与已知的 CSAM 配置文件交叉检查您的照片和消息,并在必要时向当局报告。

Apple 会扫描您 iPhone 上的所有照片吗?

不,Apple 不会扫描支持 iOS 15 的 iPhone 中的所有照片。它将使用设备上的机器学习来交叉引用您上传到 iCloud 的照片,并记录可疑的 CSAM 条目。如果您不将照片上传到 iCloud,CSAM 服务默认处于禁用状态。

CSAM 检测适用于旧照片还是仅适用于新照片?

CSAM 检测适用于旧照片和新照片。如果有人拥有暗示对儿童进行性虐待的媒体文件,CSAM 会立即通知当局并采取适当的行动。

CSAM 如何处理无辜照片?

iCloud 中照片的 CSAM 检测通过用已知的 CSAM 图像交叉检查照片来工作。如果未识别出匹配项,则该照片将亮起绿灯。因此,如果您担心 Apple 在您的智能手机上报告您孩子的裸体/半裸图像,请放心,该公司正在与多个组织合作,以确保没有虚假报告被登记。

政府会使用苹果的设备上扫描吗?

苹果一直是隐私的坚定支持者,以至于它以自己是最私密的公司而自豪。因此,当 Apple 提出设备上扫描时,警报开始响起。然而,Apple 已保证政府或任何其他方不会使用儿童安全系统来扫描用户的个人文件。整个系统是完全可审计的,并且有许多故障安全措施来保护用户数据。

Win 11系统之家

Win 11系统之家