苹果加入战场,发布了自己的大语言模型 MM1,这是一个最高有 30B 规模的多模态 LLM 。MM1模型展现了一些吸引人的特性,如上下文内预测、多图像推理和少样本学习能力。

MM1论文里面对多模态模型训练的过程和参数写的异常详细。现在都反过来了,以前开放的不再开放,以前封闭的现在变得开放了。

论文关键信息:

- 图像分辨率、图像编码器的预训练数据和模型大小对性能有显著影响。

- 视觉-语言连接器的设计相比之下影响较小。

- 预训练数据的混合比例对于少样本和零样本(zero-shot)性能至关重要。

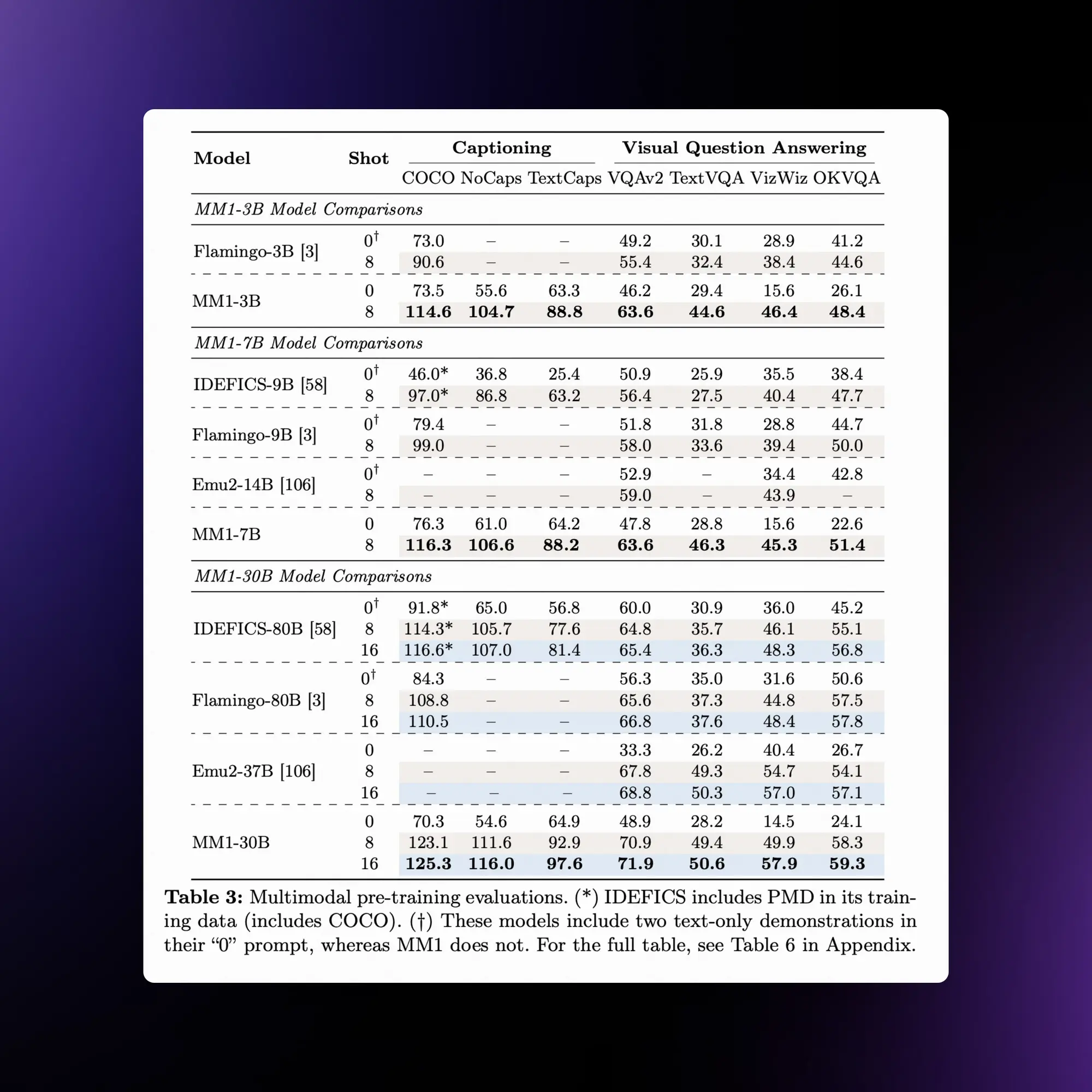

- 通过预训练和SFT,MM1模型在多个基准测试中取得了SOTA性能。

论文中不仅深入讨论了众多架构设计,还透露了他们使用了由GPT-4V生成的数据进行训练。

更令人惊讶的是,他们提供了非常精确的缩放律系数(scaling law coefficients)(精确到四位有效数字)、混合专家设置(MoE settings),甚至是最优学习率函数(optimal learning rate functions)的详细信息。

Win 11系统之家

Win 11系统之家