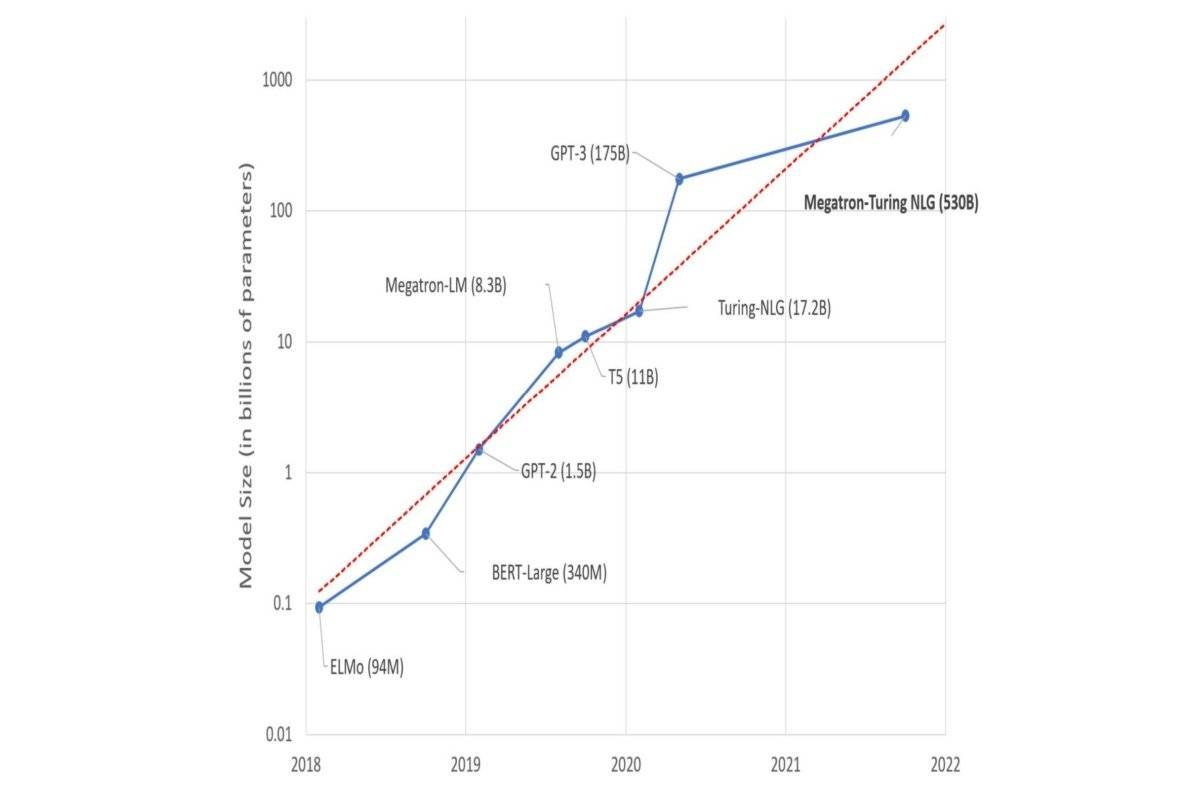

微软和英伟达今天宣布推出由 DeepSpeed 和威震天驱动的威震天图灵自然语言生成模型 (MT-NLG),这是迄今为止训练的最大、最强大的单片转换器语言模型。该模型包含 5300 亿个参数,是现有最大模型 GPT-3 的参数数量的 3 倍。训练如此大的模型涉及各种挑战。NVIDIA 和微软在所有 AI 轴上都致力于许多创新和突破。

微软和英伟达今天宣布推出由 DeepSpeed 和威震天驱动的威震天图灵自然语言生成模型 (MT-NLG),这是迄今为止训练的最大、最强大的单片转换器语言模型。该模型包含 5300 亿个参数,是现有最大模型 GPT-3 的参数数量的 3 倍。训练如此大的模型涉及各种挑战。NVIDIA 和微软在所有 AI 轴上都致力于许多创新和突破。

例如,NVIDIA 和微软紧密合作,通过将最先进的 GPU 加速训练基础设施与尖端的分布式学习软件堆栈进行融合,实现了前所未有的训练效率。我们用数千亿的token构建了高质量的自然语言训练语料库,并共同开发了训练配方,以提高优化效率和稳定性。

Win 11系统之家

Win 11系统之家